2023-09-15 12:50:25

Los investigadores demuestran un nuevo método para crear y editar avatares 3D mediante difusión estable y una nueva representación 3D híbrida de humanos digitales.

Las nuevas técnicas de inteligencia artificial permiten crear avatares virtuales de seres humanos cada vez más realistas. Dos proyectos de investigación recientes del Instituto Max Planck de Sistemas Inteligentes y otros organismos demuestran ahora enfoques que desentrañan distintos componentes de un avatar, como el cuerpo, la ropa y el pelo, para permitir operaciones de edición e incluso capacidades generativas de texto a avatar.

Desentrañar el cuerpo, la ropa y el pelo ayuda a la generación

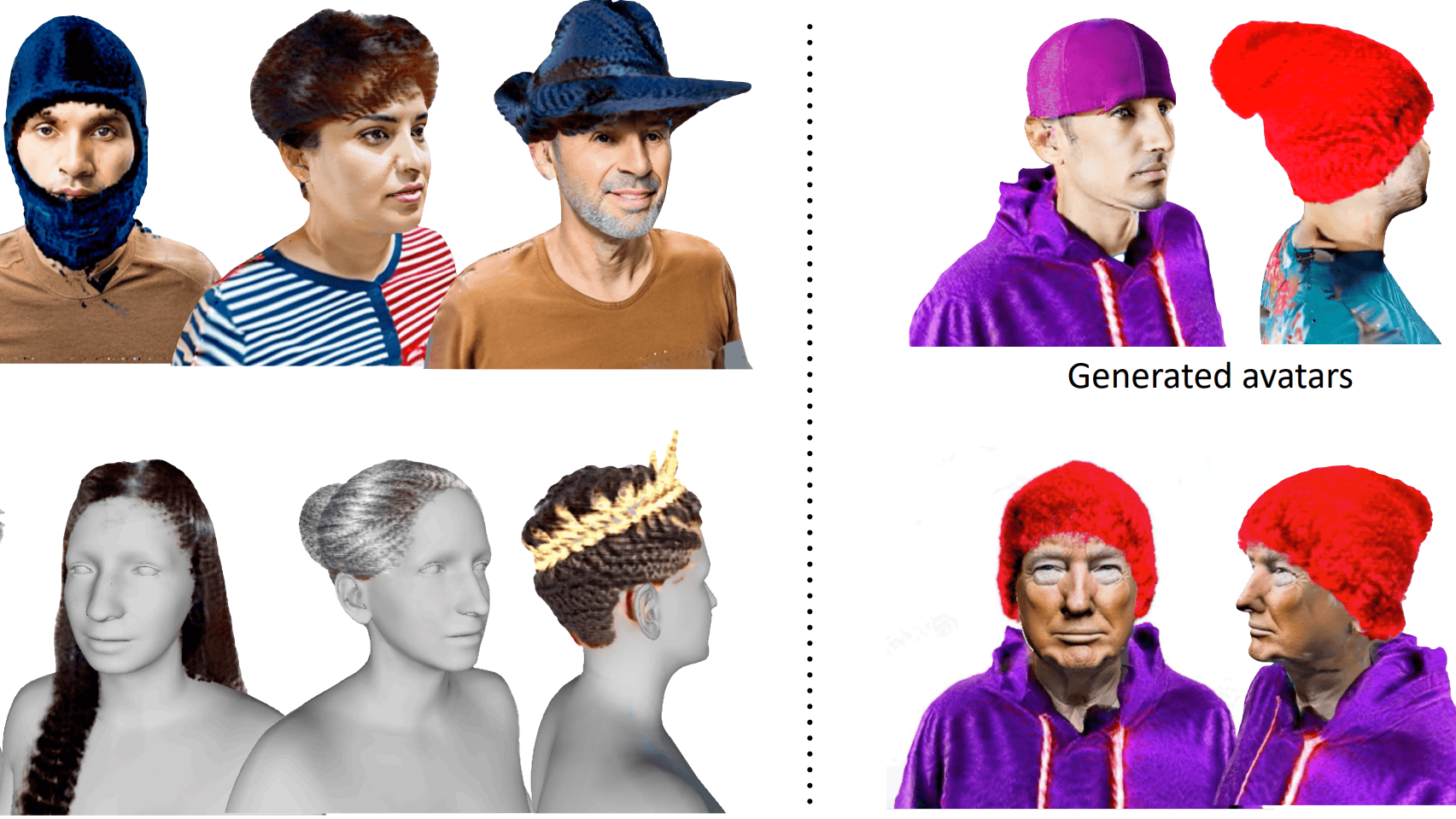

En un artículo titulado «DELTA: Learning Disentangled Avatars with Hybrid 3D Representations», los investigadores presentan un método para crear avatares con capas separadas para el cuerpo y la ropa y el pelo. Su idea clave es utilizar diferentes representaciones 3D para los distintos componentes: El cuerpo se modela con un modelo explícito basado en mallas, mientras que la ropa y el pelo se representan con un campo de radiación neuronal (NeRF) que puede capturar formas y apariencias complejas.

Para crear un nuevo avatar, DELTA sólo necesita un vídeo monocular RGB como entrada. Una vez entrenado, el avatar permite aplicaciones como el ajuste virtual de ropa o la edición de formas. La ropa y el pelo pueden transferirse sin problemas entre diferentes formas corporales.

Vídeo: Feng et al.

El método de conversión de texto en avatar TECA utiliza DELTA

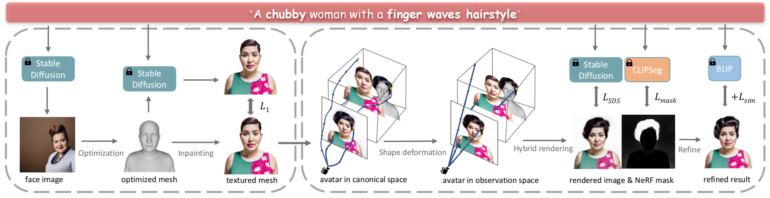

En «TECA: Text-Guided Generation and Editing of Compositional 3D Avatars», los investigadores abordan la tarea de crear avatares a partir únicamente de descripciones textuales. Para ello, utilizan la difusión estable y las representaciones 3D híbridas desarrolladas en DELTA.

El sistema genera primero una imagen de la cara a partir de la descripción del texto utilizando Stable Diffusion, que sirve como referencia para la geometría 3D, y luego pinta iterativamente la malla con una textura. A continuación, añade secuencialmente pelo, ropa y otros elementos utilizando NeRFs guiados por segmentaciones CLIP.

Los avatares compositivos generados con este método presentan una calidad significativamente mayor que las técnicas anteriores de conversión de texto en avatar. Los investigadores afirman que el desentrañamiento también permite una potente edición mediante la transferencia de atributos entre avatares.

Más información, ejemplos y código en DETLA y TECA’s GitHub.