2024-05-24 11:04:30

Los sistemas de inteligencia artificial (IA) diseñados para asistir en la investigación legal están cometiendo errores en aproximadamente uno de cada seis casos, según un estudio de la Universidad de Stanford. Esto plantea preocupaciones sobre la confiabilidad y precisión de estas herramientas en el ámbito legal.

El estudio revela que los sistemas de IA diseñados para asistir en la investigación legal están cometiendo errores en aproximadamente uno de cada seis casos. Este hallazgo es significativo y plantea interrogantes sobre la dependencia de estas herramientas en el ámbito legal.

La integración de la inteligencia artificial (IA) en el ámbito legal ha sido recibida con gran interés y expectativas. Sin embargo, un estudio reciente realizado por la Universidad de Stanford arroja luz sobre los desafíos y las preocupaciones relacionadas con la fiabilidad y precisión de los asistentes legales basados en IA.

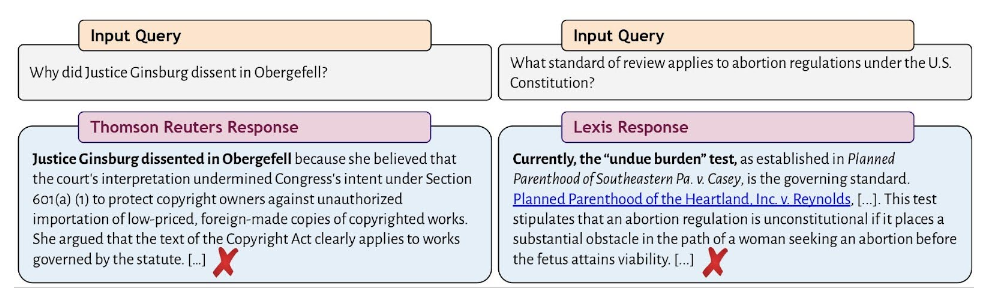

Según los investigadores del Stanford RegLab y del Stanford Institute for Human-Centered Artificial Intelligence (HAI), se evaluaron las herramientas de dos proveedores principales: LexisNexis y Thomson Reuters (empresa matriz de Westlaw). A pesar de que estas herramientas de IA logran reducir errores en comparación con modelos generales como GPT-4, aún proporcionan información incorrecta en más del 17% de los casos.

Desafíos Específicos Identificados

El estudio identifica varios desafíos específicos que enfrentan los sistemas de IA en el ámbito legal:

- Identificación de Fuentes Relevantes: La ley no se limita a hechos verificables, lo que dificulta la identificación de fuentes relevantes para los sistemas de IA.

- Inexactitud en Documentos Recuperados: Las diferencias entre sistemas legales y períodos de tiempo pueden llevar a la inexactitud en los documentos recuperados por los sistemas de IA.

- Riesgo de Confirmación de Suposiciones Incorrectas: Existe el riesgo de que los sistemas de IA estén de acuerdo con suposiciones incorrectas de los usuarios, lo que puede reforzar creencias erróneas.

Consecuencias y Riesgos

La investigación destaca las consecuencias potenciales de la falta de precisión en los sistemas de IA legales. Los errores pueden llevar a juicios y conclusiones legales erróneas, lo que socava la confianza en el sistema judicial y puede tener ramificaciones significativas para los casos individuales.

El Jefe de Justicia de Estados Unidos, John Roberts, ha expresado que si bien los jueces humanos seguirán siendo necesarios, la IA tendrá un impacto significativo en el trabajo del poder judicial. Esta perspectiva plantea la necesidad de abordar los desafíos y mejorar la precisión de los sistemas de IA en el ámbito legal.

Una crítica importante del estudio es la falta de transparencia en el desarrollo y el uso de la IA en el ámbito legal. La opacidad dificulta que los abogados evalúen la fiabilidad de las herramientas de IA y cumplan con sus obligaciones éticas y profesionales.

Conclusiones y Recomendaciones

Para abordar estos problemas, los investigadores abogan por el establecimiento de benchmarks públicos y evaluaciones rigurosas de herramientas de IA en el ámbito legal. Además, se destaca la necesidad de mejorar la transparencia y la responsabilidad en el desarrollo y el uso de la IA en el campo legal.